在linux环境中,hadoop分布式文件系统(hdfs)采用多重机制来保证数据的安全性。以下是几个重要的安全保障方法:

-

认证与授权:

- Kerberos认证:确保仅允许经过验证的用户访问文件系统。

- ACLs(访问控制列表):设定文件和目录的ACLs,限定特定用户或用户组的访问权限。

- 基于角色的访问控制(RBAC):通过定义角色和权限,实现更细致的用户资源访问控制。

-

数据加密:

- 传输层加密:利用ssl/TLS协议对客户端与HDFS间的数据传输进行加密。

- 存储加密:在HDFS层面启用数据加密,比如使用HDFS的加密区域(Encryption Zones)功能,对特定目录的数据进行加密存储。

-

数据完整性:

- 校验和:在写入数据时生成校验和,并在读取时验证校验和,确保数据的完整性。

- 副本机制:借助数据副本机制提升数据的可靠性,即便部分数据块受损或遗失,也能从其他副本中恢复。

-

审计日志:

- 记录所有对文件系统的操作,包括读、写、删除等,便于安全审计和追踪。

-

隔离与分区:

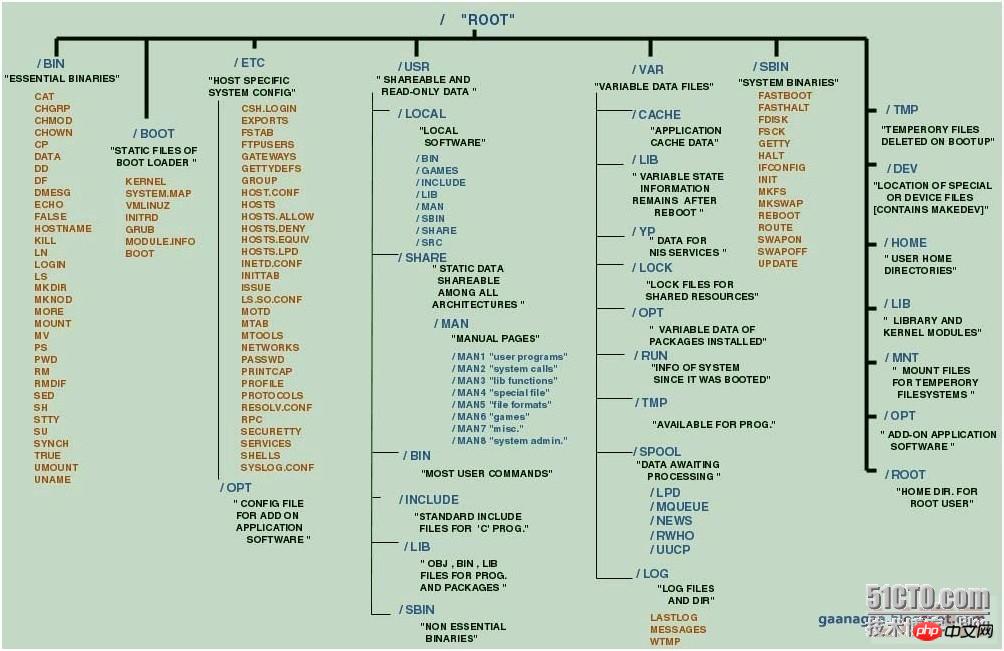

- 命名空间隔离:通过命名空间隔离区分不同用户和应用,避免数据混淆。

- 数据分区:将数据分存于不同集群或节点上,增强安全性并优化性能。

-

安全配置与管理:

- 安全配置文件:通过 core-site.xml、hdfs-site.xml等配置文件进行安全配置。

- 安全策略:制定并执行安全策略,涵盖密码策略、账户锁定策略等内容。

-

监控与告警:

- 借助监控工具(如prometheus、grafana)监控HDFS运行状况及安全事件。

- 设定告警规则,一旦发现异常行为或安全事件,即时通知管理员。

借助以上措施,可在Linux环境下高效保障HDFS的数据安全。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END