在centos系统中搭建hdfs(hadoop分布式文件系统)需要经过一系列步骤,以下是详细的指南:

1. 环境准备

- 安装JDK:确保您的系统已安装JDK 8或更高版本。

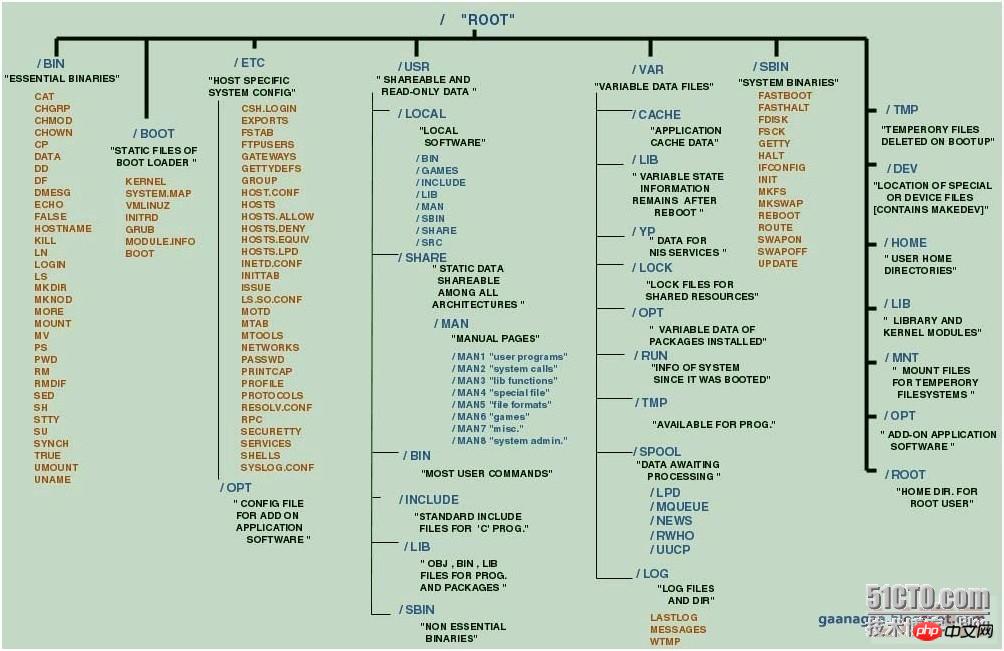

- 网络配置:设置静态IP地址,编辑 /etc/sysconfig/network-scripts/ifcfg-ens33 文件,将 ONBOOT 设置为 yes,BOOTPROTO 设置为 Static。修改主机名,编辑 /etc/hostname 和 /etc/hosts 文件,确保每个节点的主机名是唯一的且能正确解析。

2. 安装Hadoop

- 下载Hadoop:从apache Hadoop的官方网站下载最新的Hadoop安装包。

- 解压安装包:将下载的安装包解压到指定目录,例如 /usr/local/hadoop。

3. 配置Hadoop环境变量

- 编辑配置文件:

- core-site.xml:

<configuration> <property> <name>fs.defaultFS</name> <value>hdfs://namenode:9000</value> </property> <property> <name>hadoop.tmp.dir</name> <value>/usr/local/hadoop/tmp</value> </property> </configuration>

- hdfs-site.xml:

<configuration> <property> <name>dfs.replication</name> <value>3</value> </property> <property> <name>dfs.namenode.name.dir</name> <value>/usr/local/hadoop/hdfs/namenode</value> </property> <property> <name>dfs.datanode.data.dir</name> <value>/usr/local/hadoop/hdfs/datanode</value> </property> </configuration>

- yarn-site.xml 和 mapred-site.xml:用于配置YARN和mapreduce。

- core-site.xml:

- 设置环境变量:编辑 /etc/profile 文件,添加Hadoop路径和环境变量:

export HADOOP_HOME=/usr/local/hadoop export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

使配置生效:

source /etc/profile

4. 格式化NameNode

首次启动HDFS时,需要格式化NameNode:

hdfs namenode -format

5. 启动HDFS

在NameNode节点上启动HDFS:

start-dfs.sh

6. 验证HDFS状态

使用以下命令检查HDFS的运行状态:

jps

确保NameNode、DataNode和SecondaryNameNode进程正常运行。

7. 验证配置

- 创建和上传文件:

- 创建HDFS目录:

hdfs dfs -mkdir /user/test

- 上传本地文件到HDFS:

hdfs dfs -put /path/to/localfile /user/test

- 列出HDFS中的文件:

hdfs dfs -ls /user/test

- 创建HDFS目录:

8. 常见问题及解决方案

- DataNode无法连接到NameNode:检查 /etc/hosts 文件和防火墙设置,确保所有节点之间可以互相解析和通信。

- NameNode无法启动:检查配置文件中的 dfs.namenode.name.dir 和 dfs.datanode.data.dir 路径是否正确。

通过以上步骤,您可以在centos上顺利安装和配置HDFS。如果遇到问题,请查看相关日志文件和配置文件进行故障排查。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END